科学家开发了一种对抗技术可骗过Deepfake鉴别系统

随着Deepfake技术的发展,判断一个视频是否被操控变得越来越困难。幸运的是,技术人员已经开发出了复杂的神经网络来检测假脸。然而计算机科学家上周透露,他们有办法骗过最强大的检测模型,使其认为Deepfake生成的内容是真实的。

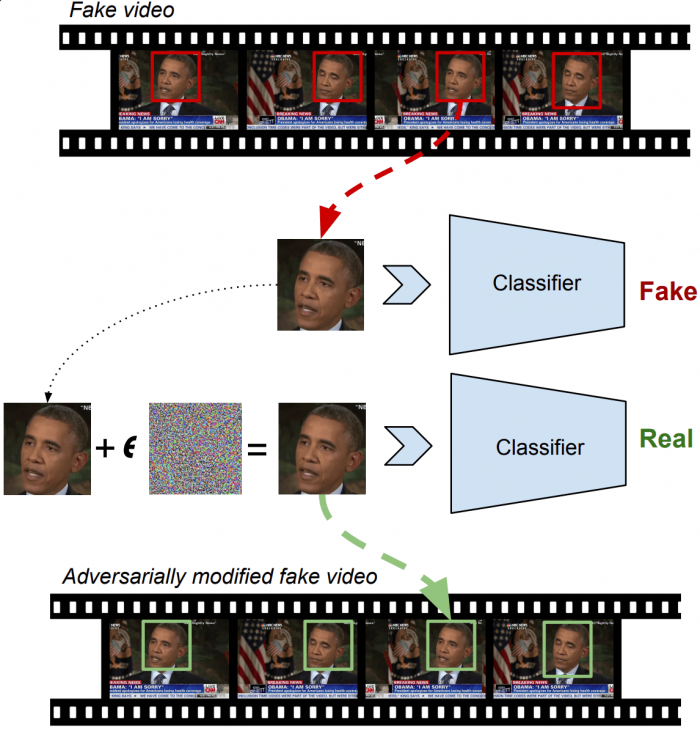

加利福尼亚大学圣地亚哥分校的研究人员开发了一种技术,一种可以欺骗为检测深层Deepfake假视频而训练的算法。计算机科学家采用两步法,将一个可检测到的Deepfake伪造的每一帧视频中插入一个 “对抗性案例”层,以创建一个几乎无法检测到的新假视频,目的是尽可能简单地操纵图像,使机器学习系统错误地识别图像。我们过去看到的一个例子是对抗性贴纸,甚至是用于欺骗自动车辆误读交通标志的电气胶带。然而,与交通标志的污损不同,UCSD的方法不会改变所产生的视频的视觉外观。这方面很重要,因为目标是同时欺骗检测软件和观众。

研究人员演示了两种类型的攻击–“白盒 “和 “黑盒”。白盒模式下,对抗行为人知道目标检测模型的一切,而黑盒攻击是指攻击者根本不知道检测Deepfake所使用的分类架构,目前看来这种方式相当有效,甚至可以骗过当下最先进的检测系统。

Deepfakes自几年前在互联网上出现以来,已经激起了不少争议。起初,主要是名人对自己的肖像出现在色情视频中感到愤怒。然而,随着技术的改进,很明显,坏人可以利用它进行宣传或有更邪恶的目的。

不少大学率先开发出检测Deepfake的算法,美国国防部也迅速跟进。包括Twitter、Facebook和微软在内的一些科技巨头也一直在开发在其平台上检测Deepfake的方法。研究人员表示,对抗这种技术的最佳方法是对检测系统进行对抗性训练。

该小组在GitHub上发布了几个工作实例:

https://adversarialdeepfakes.github.io/

对于那些对技术细节感兴趣的人,可以查看通过康奈尔的arXivLabs发表的论文: