Tinygrad:一个简单而强大的神经网络框架

在深度学习时代,谷歌、Facebook、百度等科技巨头开源了多款框架来帮助开发者更轻松地学习、构建和训练不同类型的神经网络。而这些大公司也花费了很大的精力来维护 TensorFlow、PyTorch 这样庞大的深度学习框架。

在深度学习时代,谷歌、Facebook、百度等科技巨头开源了多款框架来帮助开发者更轻松地学习、构建和训练不同类型的神经网络。而这些大公司也花费了很大的精力来维护 TensorFlow、PyTorch 这样庞大的深度学习框架。

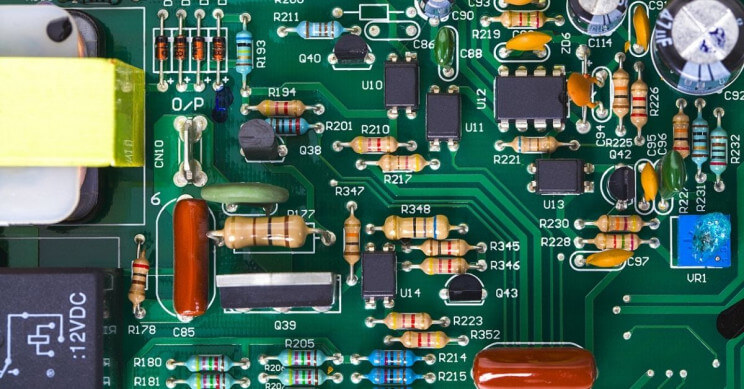

深度学习是一个能源密集型领域,它的应用受到了限制。但如果这些模型能够以更高的能源效率来运行呢?这是许多研究人员提出的问题,而IBM的一个新团队可能已经找到了答案。

近日,清华大学微电子所、未来芯片技术高精尖创新中心的钱鹤、吴华强教授团队与合作者在《自然•纳米科技》在线发表研究论文,通过引入具有丰富动态特性的人工树突计算单元,构建了包含突触、树突以及胞体的新型人工神经网络,在提高网络计算准确率的同时显著降低了系统功耗。